- Messaggi: 488

- Ringraziamenti ricevuti 158

-

-

- Scontro mortale fr...

- Bellissimo! Ne voglio ancora!

- da peterpan3

- 16/06/2024 13:47

-

-

-

- Videoteca (Confere...

- GLI DEI ROMANI RIVELATI Mauro Biglino e Gian Matteo Corrias

- da Bastion

- 16/06/2024 12:57

-

-

-

- Storia proibita - ...

- EL MIRADOR E LA CIVILTA' PERDUTA DEI MORMONI Josè Sanchez Oro La giungla del Petén in Guatemala nasconde...

- da Bastion

- 16/06/2024 12:55

-

-

-

- L'angolo dei Meme

- da Nomit

- 16/06/2024 09:10

-

-

-

- Cosa state ascolta...

- Margò – Sto Finley – Fuori di testa Isa Jam – Luna piena Subsonica - Universo Antonello Mei - Arantxa

- da Nomit

- 15/06/2024 23:38

-

-

-

- Rapporto sulle Sci...

- L'intento del topic sarebbe anche lodevole, ma credo non porterà a granchè. Mia opinione è infatti che la...

- da valis

- 15/06/2024 12:46

-

-

-

- Voci della Confede...

- Ciao a tutti.Io so canalizzare, posso entrare in contatto con Esseri evoluti o con i defunti. Ma non so...

- da Orso

- 14/06/2024 15:21

-

-

-

- UFO e alieni - Rac...

- UAP E INTELLIGENZE NON UMANE - PARTE 01 Bernanrdo Kastrup I più recenti sviluppi degli ultimi sei o sette...

- da Bastion

- 13/06/2024 13:26

-

-

-

- Finestre di Overto...

- altra finestra spalancata: La modalità dio dell’intelligenza artificiale...

- da marlo

- 12/06/2024 15:24

-

Analisi anomalie foto Apollo con strumenti matematici

- kamiokande

-

- Offline

- Premium Member

-

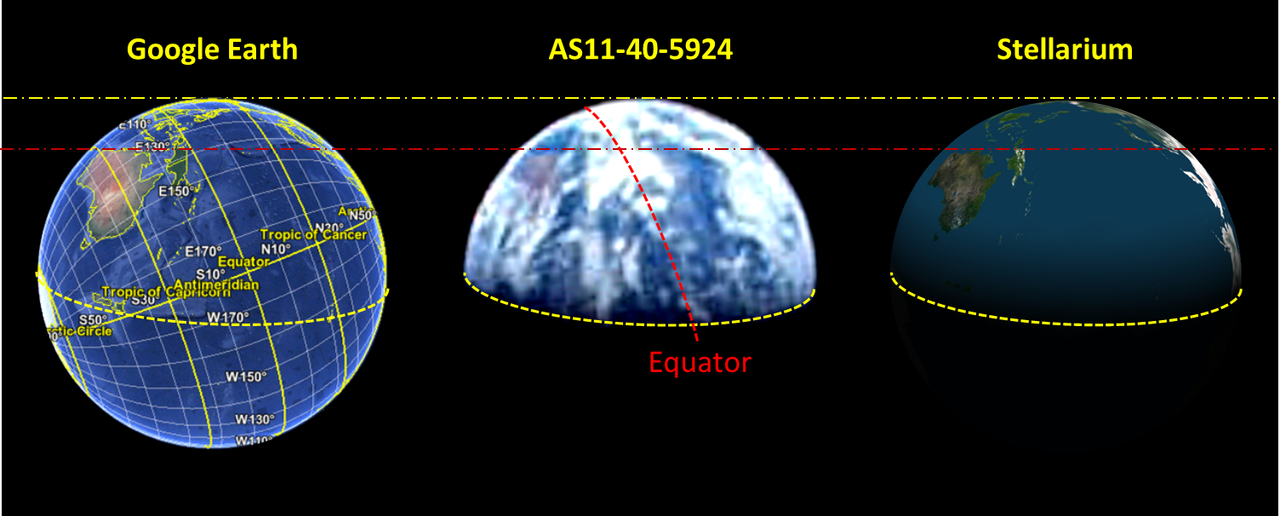

Registered

Vado un po' off-topic. Forse ho trovato un'incongruenza riguardo alla foto esaminata AS11-40-5924 che però non riguarda le dimensioni dell'immagine della Terra. Osservando con Stellarium la Terra al 21 luglio del 1969 alle 4:22 UTC (quando sarebbe stata scattata la foto) possiamo verificare la corrispondenza dell'illuminazione tra l'immagine generata dal software e la foto.

Isolando ed identificando alcune formazioni nuvolose è possibile verificare la data nel quale la foto è stata scattata.

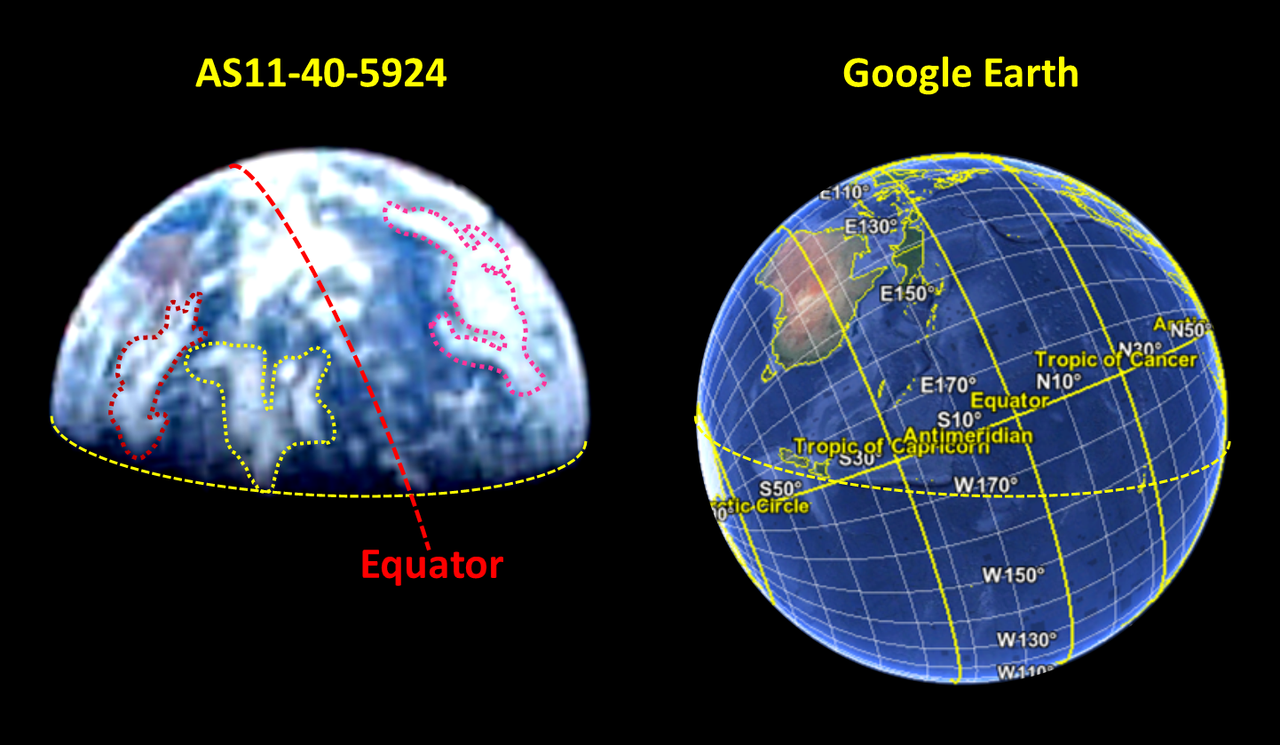

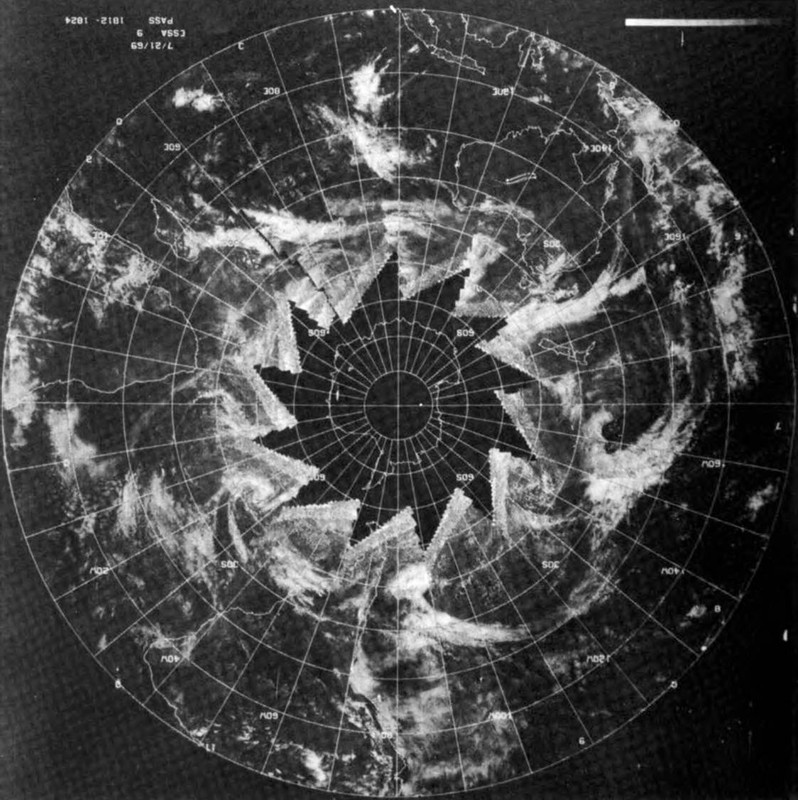

Consultando il documento Key to meteorological records documentation no.5.323 , possiamo vedere, con l'aiuto di Google Earth, che quelle formazioni nuvolose si possono trovare il 20 luglio 1969.

Emisfero Nord - 20 Luglio 1969

Emisfero Sud - 20 Luglio 1969

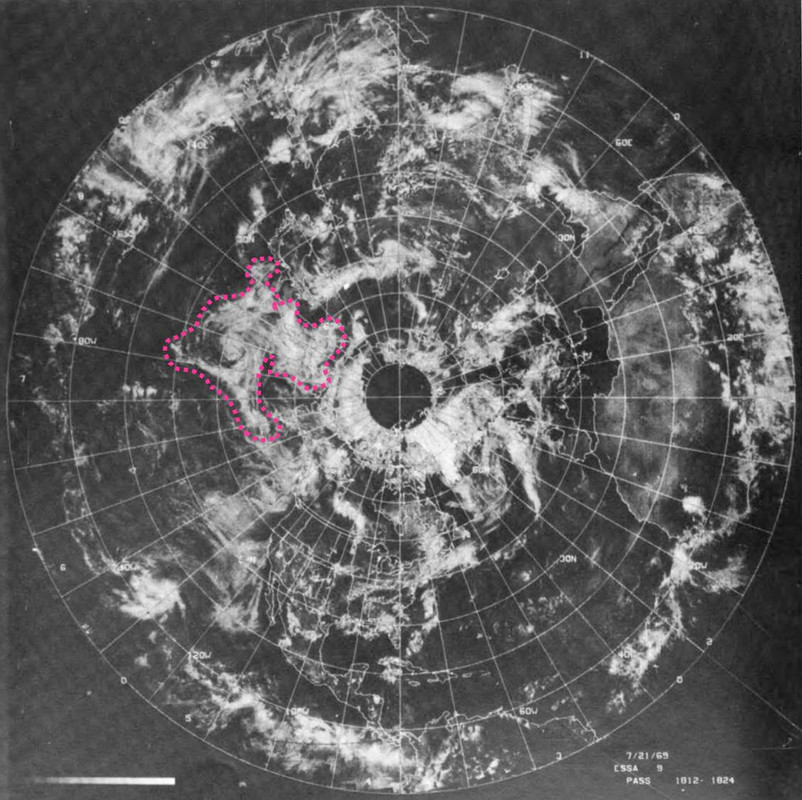

Emisfero Nord - 21 Luglio 1969

Emisfero Sud - 21 Luglio 1969

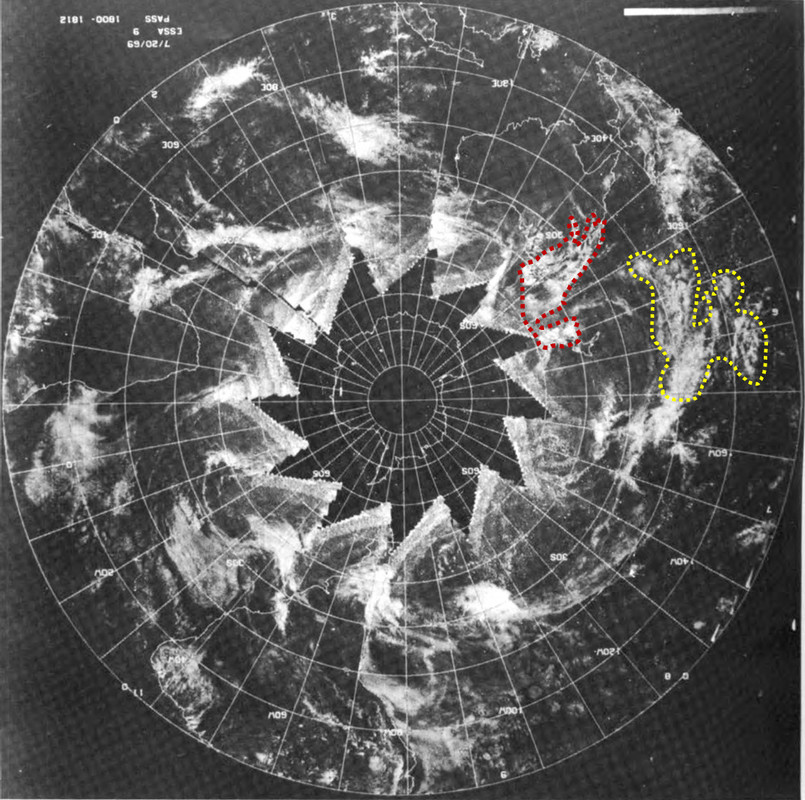

Le formazioni nuvolose dell'emisfero Sud non sono presenti il 21 Luglio, mentre la formazione ciclonica nell'emisfero Nord presenta una forma differente. Se la costruzione delle mappe è su base giornaliera è quindi possibile che la foto AS11-40-5924 sia sta scattata non il 21 ma il 20 luglio alle 4:22 UTC, quando la Terra occupava la stessa posizione rispetto al Sole.

Esiste però un incongruenza tra la data riportata sulle mappe ed i passaggi (PASS) che rende l'interpretazione delle mappe non immediata. Ci sono due possibilità:

1) Le mappe sono su base giornaliera dalle 00:00 GMT alle 24:00 GMT di ogni singolo giorno ma i passaggi indicati servono solo a garantire la sovrapposizione tra la fine di una mappa e l'inizio della successiva, nel documento "Key to meteorological records documentation no.5.323" viene specificato che la sovrapposizione viene effettuata nel planisfero tra i 60°E e gli 80°E che il satellite ESSA 9 sorvola intorno alle 10 GMT.

2) Le mappe sono generate dai passaggi indicati ovvero tra le 10:00 GMT del giorno indicato e le 10:00 GMT del giorno successivo, quindi la data indicata sulle mappe perde di significato e metà planisfero è riferito al giorno indicato e metà nel giorno successivo.

Benché io trovi alquanto strano che sia vero il secondo caso, nel caso fosse quello corretto le formazioni nuvolose corrisponderebbero al momento in cui le foto sarebbero state scattate, altrimenti occorrerebbe retrodatare di un giorno tutte le foto in cui compare la Terra con pesanti ripercussioni sui dati riportati dalla NASA. Devo verificare con altre immagini satellitari quale delle due sia corretto. Esistono comunque altre incongruenze legate alla foto analizzata che meritato di essere valutate.

AGGIORNAMENTO

Ho verificato che effettivamente il secondo caso è quello corretto quindi le foto della Terra sono fisicamente coerenti nel momento in cui ufficialmente sono state scattate. Mi scuso per la svista.

"La stampa è morta" (Egon Spengler - Ghostbuster)

Accedi al sito per partecipare alle discussioni.

doktorenko ha scritto: Nel mesaggio #8127 pero` avevo scritto di aver intenzione di alleggerire per un po` la discussione, postando finalmente delle immagini, per interrompere questi infiniti preliminari matematici (che sono pero` doverosi).

Sono d'accordo, e anche se non lo fossi il thread lo hai aperto tu e sei libero di impostarlo come preferisci, solo che è più forte di me, le imprecisioni matematiche (anche e soprattutto le mie, vedi il mio primo commento) mi causano prurito e altri sintomi fastidiosi finchè non vengono estirpate...

Io ho provato con gli stessi angoli, ma a me l`ellisse rimane "in forma". Io uso questa equazione (copio direttamente da Geogebra):

F = 61.1 d=tan(δ) F h=F sec(δ) r(t)= h sin(ρ) / sin(ρ - acos(sin(δ) cos(t - α))) Curva[d cos(α) + cos(t) r(t), d sin(α) + sin(t) r(t), t, 0, 2π]

Io mi riferivo alla prima equazione che avevi postato, che in effetti riguardando sarebbe la 1) del commento #8096. Che però non è equivalente a questa qui sopra, come dici alla fine dello stesso commento. Comunque anche quest'ultima equazione è una quartica, solo che la cosa diventa evidente al crescere di delta invece che di rho come in quell'altra:

Qui ho usato delta=65° e rho=15°

Scusami, se io volessi controllare la mia equazione con la tua del messaggio #8123, come devo scriverla in geogebra, usando la mia convenzione (angolo delta, raggio rho, focale F, ecc.)? potresti riportarla in formato testo, citandola tra i marcatori code? Anche perche` abbiamo visto che le immagini potrebbero sparire, mentre lo scritto no ;-)

(1-tan(rho)^2*tan(delta)^2)*x^2+(1+tan(delta)^2)*y^2+2*F*tan(delta)*(1+tan(rho)^2)*x+F^2*(tan(delta)^2-tan(rho)^2)=0Questa è l'equazione implicita, per controllare che un'equazione parametrica definisca gli stessi punti devi sostituire x(t) e y(t) alle x,y dell'equazione e verificare che risulti 0=0. Nel tuo caso dovresti porre alfa=180° per un'eventuale coincidenza, ma il grafico qui sopra ci dice già che non potrà esserci.

@kamiokande

Interessante la tua analisi delle nuvole, direi che ammettendo che sia corretta dimostrerebbe due cose:

-l'immagine è un fotomontaggio

-l'immagine della terra è una vera immagine di un satellite (speriamo che non mi legga un tarrapiattista), mi sembra troppo complicato realizzare un modello con riproduzione fedele delle nuvole a una data prefissata (inoltre a quel punto potevano scegliere la data giusta...).

Questo significherebbe anche che l'immagine della terra è in realtà in origine digitale, mi sembra improbabile che abbiano fatto foto su pellicola con un satellite e poi recuperato il rullino....

FranZη

Accedi al sito per partecipare alle discussioni.

- kamiokande

-

- Offline

- Premium Member

-

Registered

- Messaggi: 488

- Ringraziamenti ricevuti 158

Ho seguito il procedimento usato da un certo Paul White, che usa questo metodo per dimostrare che la Terra nelle foto delle missioni Apollo è autentica e di conseguenze che le foto sono autentiche. Ho però sbagliato ad interpretare le foto del satellite, leggendo il documento mi sono reso conto che sono fatte con un unico satellite (ESSA 9) che sorvola la Terra tra le 12 e le 13 volte per fotografare tutta la Terra, quindi quello che io ho creduto essere l'ora di assemblaggio dell'immagine, sono invece i passaggi (PASS), ricontrollo le mie affermazioni e poi edito il mio post con le considerazioni corrette.

"La stampa è morta" (Egon Spengler - Ghostbuster)

Accedi al sito per partecipare alle discussioni.

- kamiokande

-

- Offline

- Premium Member

-

Registered

- Messaggi: 488

- Ringraziamenti ricevuti 158

Ho editato il post aggiungendo la suddetta conclusione.

Ci sono però altre possibili incongruenze che voglio verificare, prima però controllerò tre volte i dati prima di postare qualcosa.

"La stampa è morta" (Egon Spengler - Ghostbuster)

Accedi al sito per partecipare alle discussioni.

- doktorenko

-

Autore della discussione

Autore della discussione

- Offline

- Senior Member

-

Registered

- Messaggi: 169

- Ringraziamenti ricevuti 8

Non ti devi preoccupare di andare fuori tema finche` la discussione rimane sul piano dell`analisi geometrico-matematica, piuttosto che quello dell`impressione soggettiva.

E` interessante lo studio delle formazioni nuvolose, tra le altre cose sto cercando di separare (previo raddrizzamento) i vari elementi dell`immagine (mare, atmosfera, terra, nuvole) e riproiettarli su di una sfera, per analizzarli meglio; magari anche per valutare se l`illuminazione e` corretta.

Ritorniamo ora all`analisi che abbiamo iniziato, vi spiego la procedura di raddrizzamento; indichiamo con:

F=61.1: lunghezza focale

O(0,0,0): foro stenopeico della camera, posto all`origine (0,0,0)

p:y=-F: piano bidimensionale xz del sensore, contenente l`immagine della Terra: I[riga,colonna]=RGBLa teoria e` che tutti i piani perpendicolari alla retta congiungente il centro della sfera reale e il punto O contengono l`immagine bidimensionale non distorta della sfera; una prima procedura allora potrebbe essere questa:

1) centriamo sul piano p l`immagine da elaborare, ponendo la crocetta grande sul punto O_1

O_1=(0,F,0)C=(x,F,z)r=O+t*Cp1: C1_x*x+C1_y*y+C1_z*z=d

d=C_1x**2+C1_y**2+C1_z**2P(r,F,c), con x=r, z=c, y=Ft=d/(P_x*C1_x+P_y*C1_y+P_z*C1_z)P1=P*tIl problema adesso e` rendere bidimensionale il pianop1, ma forse sarebbe meglio allora, in maniera speculare, distorcere il piano p, che e` gia` bidimensionale. Si potrebbe semplificare anche orientando l`immagine preventivamente, facendo coincidere il centro della Terra con uno degli assi x y passanti per il centro della foto, ma vorrei evitare le rotazioni, perche` potrebbero portare ad una perdita di informazione.

Seconda procedura:

1)calcolo gli angoli di inclinazione del piano p1, rispetto al piano xz del sensore:

alpha=atan(C1_x/C1_y)

beta=-atan(C1_z/sqrt(C1_x**2+C1_y**2))Vettore v: (cos(alpha), -sin(alpha),0)

Vettore u: (-sin(beta)*Vy,sin(beta)*Vx,-cos(beta))P1_r_c = C1+u*c+v*rt=-F/y

P_r_c=P1_r_c*tI1[r,c]=I[P1_r_c_x,P1_r_c_y].Bisogna pero` fare attenzione a questi aspetti:

1) la stima preventiva del centro della Terra sull`immagine

2) differenza tra lunghezza focale dichiarata e effettiva

3) la distorsione introdotta porta ad una perdita/degrado dell`informazione

La 1 e` marginale perche` dovrebbe influire poco sul risultato finale (pochi pixel di differenza corrispondono a frazioni minime di angolo), mentre la 2 e` piu` importante perche` pochi millimetri di lunghezza focale possono variare molto di piu` lo scostamento angolare calcolato, e quindi la deformazione dell`immagine; la 3 e` da valutare

Accedi al sito per partecipare alle discussioni.

- kamiokande

-

- Offline

- Premium Member

-

Registered

- Messaggi: 488

- Ringraziamenti ricevuti 158

Io ho calcolato che la dimensione della Terra non distorta (considerando anche la parte non visibile) con una focale di 61.1mm dovrebbe essere di 2.016mm, considerando che la distanza tra i marker è di 10mm. Il semiasse maggiore della Terra distorta dovrebbe essere di 2.0799mm, quindi la differenza è di circa 3.1% e non so quanto sia apprezzabile e considerando gli errori che si commettono sempre.

Si ha all'incirca la stessa differenza se la lunghezza focale fosse di 63mm.

"La stampa è morta" (Egon Spengler - Ghostbuster)

Accedi al sito per partecipare alle discussioni.

- doktorenko

-

Autore della discussione

Autore della discussione

- Offline

- Senior Member

-

Registered

- Messaggi: 169

- Ringraziamenti ricevuti 8

P.s.

Ho pensato di togliere l`immagine elaborata perche` messa cosi` non e` di molta utilita`.

Accedi al sito per partecipare alle discussioni.

- doktorenko

-

Autore della discussione

Autore della discussione

- Offline

- Senior Member

-

Registered

- Messaggi: 169

- Ringraziamenti ricevuti 8

sfera raggio 1 m

camera a 60 m, scostata di 15 gradi dal centro della sfera e ruotata di 71 gradi

lunghezza focale 61.1 mm, sensore 53 mm 4000 pxPoi, con due funzioni del pacchetto scientifico per Python, ho estratto il contorno e stimato il raggio e il centro della circonferenza.

Questo e` il risultato finale:

Metto i passaggi per risalire alle dimensioni reali:

scala=2

centro_x cerchio (proiezione della sfera) calcolato = 402.3 px

centro_y cerchio calcolato = -1168.7 px

raggio R cerchio calcolato = 160.1 px

focale F = 61.1 mm; 4611.3 px

distanza d cerchio dal centro immagine = sqrt(c_x**2+c_y**2) =1236 px

distanza F1 centro cerchio dal foro stenopeico =sqrt(d**2+F**2) = 4774.1 px

distanza D foro stenopeico-piano di riproiezione = s*F1

diametro angolare = atan (R/D) = 0.96 gradi

diametro reale con distanza 60 m = 60000*R/D = 1.006 mL`imprecisione e` di circa il 6 per mille; la procedura dovrebbe quindi funzionare "teoricamente", cioe` conoscendo con precisione la lunghezza focale dello scatto e avendo dei bordi ben definiti: due dati che nella situazione reale dobbiamo purtroppo stimare in qualche modo.

Tenuto conto di queste difficolta` io direi di passare a trattare altre eventuali anomalie "calcolabili" nelle foto Nasa; ad esempio se e` possibile stimare la curvatura lunare (tentativo che avevo gia` fatto nella discussione precedente).

P.S.

Ho trovato un errore concettuale nel calcolo del diametro reale: non dobbiamo piu` tener conto della distanza della sfera, ma del cerchio di diametro angolare asin(R/D) visibile della stessa; la nuova distanza a cui fare riferimento dovrebbe allora diventare:

60 * cos(asin(1/60))**2 = 59.983E il raggio visibile:

R * asin(1/60) = .9998Accedi al sito per partecipare alle discussioni.

- doktorenko

-

Autore della discussione

Autore della discussione

- Offline

- Senior Member

-

Registered

- Messaggi: 169

- Ringraziamenti ricevuti 8

Per me l`eccedenza potrebbe essere benissimo atmosfera e/o luminosita` "sparata" (1px = 40km).

Accedi al sito per partecipare alle discussioni.

- doktorenko

-

Autore della discussione

Autore della discussione

- Offline

- Senior Member

-

Registered

- Messaggi: 169

- Ringraziamenti ricevuti 8

Si potrebbe obiettare che la Nasa ha modellato l`ambientazione tenendo conto della curvatura: se l`ha fatto in scala 1:1 per me e` fantascientifico (ma anche senza curvatura); oppure che i dati delle sonde sono stati taroccati successivamente per combaciare con le foto: se e cosi` questi stessi dati sono la prova che cerchiamo -naturalmente potendo confrontarli con quelli di una sonda "neutrale".

Iniziamo ora da un modello "base", successivamente cerchiamo di rifinirlo il piu` possibile, visto che le differenze potrebbero essere i pochi centesimi di millimetro sulla pellicola (1 mm circa 75 px).

1) Luna = sfera di raggio R

2) nessun rilievo

3) corrispondenza esatta (a parte la scala) tra superficie mappata e quella lunareIn questo caso semplificato, se:

h(dx-cx,dy-cy) = dato altimetrico mappato

cx,cy = posizione della camera

dx,dy = distanzai punti della (Px,Py,Pz) della calotta sferica saranno:

R=raggio

x=dx-cx

y=dy-cy

theta=x/R

phi=y/R

Px= -sin(theta) * R

Py = cos(theta) * sin(phi) * R

Pz = cos(theta) * cos(phi) * R - RLa calotta e` costruita per avere il punto piu` alto = livello 0 = posizione camera.

Fin qua non dovrebbero esserci problemi, se pero` aggiungiamo il dato dell` altezza h, e` sufficiente porre:

h(dx-cx,dy-cy)=altezza terreno

R=Raggio+he lasciare invariato il resto? si introduce una approsimazione? se si`, e` trascurabile? perche` un altopiano dovrebbe avere una superficie maggiore rispetto allo stesso terreno, , sotteso allo stesso angolo, a livello del mare.

Dovrei capire come eventualmente compensare per le varie altezze, se e` proprio necessario o la differenza, per i rilievi in questione, e` praticamente irrilevante, o se i dati gia` ne tengono conto, o altro.

p.s.

Ho fatto alcuni conti e il risultato mi sembra interessante: un ipotetico altopiano che corresse lungo tutto l`equatore lunare svettando di 1 km ( R + d dal centro; d = 1 km), avrebbe un`estensione maggiore di circa 6.28 km rispetto allo stesso rilievo posto pero` a livello 0 (R dal centro); questo perche`, piuttosto contro-intuitivamente, la differenza non e` correlata con la dimensione iniziale, 2 pi * R, ma semplicemente vale 2 * pi * d: nell`esempio 1 km * 2 pi; questo per un arco di 360 gradi: ma noi trattiamo altezze e estensioni angolari minori -centinaia di metri di dislivello e decimi di grado- quindi potrebbero esserci approssimazioni nell`ordine del metro. Per il momento lascio quindi in sospeso un eventuale aggiustamento dei dati, ma mi piacerebbe comunque approfondire la questione.

Accedi al sito per partecipare alle discussioni.

doktorenko ha scritto: La procedura per verificare la corretta curvatura del terreno nelle foto Apollo consiste nel costruire un modello tridimensionale partendo dai dati digitali delle sonde (ricostruizione profilo orografico) e dagli scatti da analizzare (orientamento e posizione camera), mappare quindi la superficie risultante su di una sfera/ellissoide/"lunoide", e confrontare le altezze dei rilievi.

...1) Luna = sfera di raggio R 2) nessun rilievo 3) corrispondenza esatta (a parte la scala) tra superficie mappata e quella lunare

In questo caso semplificato, se:

h(dx-cx,dy-cy) = dato altimetrico mappato cx,cy = posizione della camera dx,dy = distanza

i punti della (Px,Py,Pz) della calotta sferica saranno:

R=raggio x=dx-cx y=dy-cy theta=x/R phi=y/R Px= -sin(theta) * R Py = cos(theta) * sin(phi) * R Pz = cos(theta) * cos(phi) * R - R

La calotta e` costruita per avere il punto piu` alto = livello 0 = posizione camera.

Fin qua non dovrebbero esserci problemi, se pero` aggiungiamo il dato dell` altezza h, e` sufficiente porre:

h(dx-cx,dy-cy)=altezza terreno R=Raggio+h

e lasciare invariato il resto? si introduce una approsimazione? se si`, e` trascurabile?

Io partirei posizionando la fotocamera nel punto (u,v)=(0,0) (quando si usano coordinate sulla sfera è meglio usare un altro nome, tenendo x,y,z per le coordinate della sfera, cioè le coordinate ortogonali dello spazio tridimensionale), a questo punto (u,v) sono precisamente le due distanze di un generico punto e si può costruire la calotta ponendo:

theta=u/R

phi=v/R

h=h(u,v)=H(theta,phi)

x = (R+H)*sin(theta)*cos(phi)

y = (R+H)*sin(theta)*sin(phi)

z = (R+H)*cos(theta)-Rx=0

y=0

z=h(0,0)MA, detto questo, usare le foto lunari per un lavoro del genere mi sembra del tutto fuori luogo, valutare la curvatura lunare sulla base delle foto nel modo sopra esposto è impossibile, l'unica possibilità è cercare di stimare la distanza o la leggerissima curvatura dell'orizzonte, ma anche in questo caso dubito che si riesca ad arrivare in pratica a qualcosa di significativo. Cercare di stabilire l'eventuale maggiore area di un altopiano lunare rispetto al livello "0" sulla base delle foto è però certamente impossibile.

piuttosto contro-intuitivamente, la differenza non e` correlata con la dimensione iniziale, 2 pi * R, ma semplicemente vale 2 * pi * d: nell`esempio 1 km * 2 pi

La differenza è ovviamente 2*pi*(R+d)-2*pi*R=2*pi*d quindi, come suggerisce il termine stesso, è correlata alla differenza fra i due raggi e non solo al raggio iniziale, non mi pare sia controintuitivo. Ma la differenza nel caso delle foto lunari è sicuramente del tutto impossibile da valutare nemmeno con mezzi molto più sofisticati di quelli usati qui, anche in caso di superficie perfettamente liscia sarebbe di circa un metro sui 2 km di distanza dell'orizzonte (con la fotocamera a 1,20 m di altezza), figuriamoci cosa possiamo concludere nel caso reale in cui sono presenti rilievi di ogni forma e dimensione.

Credo che l'unica possibilità sarebbe stata, nel caso di foto scattate in una zona particolarmente piana, cercare di stimare se l'orizzonte si trovasse ai 2 km della superficie lunare o ai 4 km della superficie terrestre, ma per i motivi già detti non credo che questa verifica sia fattibile in pratica.

FranZη

Accedi al sito per partecipare alle discussioni.

- doktorenko

-

Autore della discussione

Autore della discussione

- Offline

- Senior Member

-

Registered

- Messaggi: 169

- Ringraziamenti ricevuti 8

FranZeta ha scritto:

La differenza è ovviamente 2*pi*(R+d)-2*pi*R=2*pi*d quindi, come suggerisce il termine stesso, è correlata alla differenza fra i due raggi e non solo al raggio iniziale, non mi pare sia controintuitivo. Ma la differenza nel caso delle foto lunari è sicuramente del tutto impossibile da valutare nemmeno con mezzi molto più sofisticati di quelli usati qui, anche in caso di superficie perfettamente liscia sarebbe di circa un metro sui 2 km di distanza dell'orizzonte (con la fotocamera a 1,20 m di altezza), figuriamoci cosa possiamo concludere nel caso reale in cui sono presenti rilievi di ogni forma e dimensione.

Anch`io sono arrivato a concludere che comunque si tratta di una differenza di estensione nell`ordine del metro, e quindi praticamente impercettibile, ma non pensavo di usare questa eventuale discrepanza come prova; piuttosto il mio dubbio su come trattare i dati altimetrici era questo:

D) due pianure, aventi la stessa estensione angolare (longitudinale e latitudinale), poste pero` ad altezze diverse, sono mappate con lo stesso numero di righe e colonne di dati?

Io direi di si`: quindi, per la trasformazione delle coordinateu,v -> theta, phi bisogna dividere per il raggio standard R; per calcolare invece il punto x,y,z, si deve moltiplicare per il raggio effettivo (in quel determinato luogo) R+h. (come risulta anche dalle tue formule)

Cioe`: stessa estensione angolare in unita`/pixel , ma diversa estensione finale proiettata in metri.

Credo che l'unica possibilità sarebbe stata, nel caso di foto scattate in una zona particolarmente piana, cercare di stimare se l'orizzonte si trovasse ai 2 km della superficie lunare o ai 4 km della superficie terrestre, ma per i motivi già detti non credo che questa verifica sia fattibile in pratica.

Qui non siamo piu` d`accordo: perche` per valutare se una zona e` particolarmente piana dobbiamo necessariamente affidarci ai dati altimetrici; ma non basta: anche ricostruire la linea di orizzonte dalle sole fotografie mi sembra impossibile, non conoscendo con precisione l`orientamento della camera, che invece credo possa essere calcolato incrociando i dati altimetrici e fotografici.

Alcuni conti:

R=1.738x10^6 m

h=1.7 m

angolo a orizzonte astronomico/orizzonte lunare = acos (R/ (R+h) ) = 0.08 gradi

distanza d = (R+h) * sin (a) = 2430 m

pellicola 53 mm, 4000 px

focale F =61.1 mm, 4611 px

caduta in pixel orizzonte: F*tan (a) = 6 pxQuindi in una fotografia Apollo 61mm di una zona pianeggiante lunare, con la macchina posta a 1.7m di altezza, l`orizzonte reale dovrebbe giacere 0.08 gradi sotto quello astronomico; ossia, se la camera e` posta a piombo su di un cavalletto: 6 px sotto il centro dell`immagine.

In un ambiente terrestre i conti diventano:

a=0.04 gradi

d=4650 m

caduta=3 pxLa differenza dovrebbe essere di circa 3 px; pero` potendo fare gli stessi conti con rilievi piu` distanti si dovrebbero trovare differenze maggiori.

Accedi al sito per partecipare alle discussioni.

E chi lo sa, dipende da come sono stati rilevati i dati dalle sonde, se a intervalli regolari di tempo (quindi di angoli) o di spazio (di metri sulla superficie). Le differenze sarebbero in ogni caso minime. Quello che però è certo è che tutti questi dati provengono da agenzie spaziali, quindi potrebbero essere manipolati in partenza, mi sembra inutile domandarsi se sono organizzati in una matrice 4000x4000 o 4002x4002.doktorenko ha scritto:

D) due pianure, aventi la stessa estensione angolare (longitudinale e latitudinale), poste pero` ad altezze diverse, sono mappate con lo stesso numero di righe e colonne di dati?

La differenza dovrebbe essere di circa 3 px; pero` potendo fare gli stessi conti con rilievi piu` distanti si dovrebbero trovare differenze maggiori.

Direi che 3 pixel su 4000 sono una precisione che nemmeno se avessero fatto rilevazioni con teodolite e asta graduata potrebbe essere raggiunta. In ogni caso prima di fare ogni tipo di valutazione in questo senso bisognerebbe scegliere le foto da cui si vuole partire, in modo da poter stabilire subito se ha senso o no imbarcarsi in queste considerazioni. In sostanza, secondo me prima di imbastire modelli matematici e relative formule sarebbe opportuno chiarire bene quale dovrebbe essere il loro scopo in relazione al materiale a disposizione.

FranZη

Accedi al sito per partecipare alle discussioni.

- doktorenko

-

Autore della discussione

Autore della discussione

- Offline

- Senior Member

-

Registered

- Messaggi: 169

- Ringraziamenti ricevuti 8

FranZeta ha scritto:

Direi che 3 pixel su 4000 sono una precisione che nemmeno se avessero fatto rilevazioni con teodolite e asta graduata potrebbe essere raggiunta. In ogni caso prima di fare ogni tipo di valutazione in questo senso bisognerebbe scegliere le foto da cui si vuole partire, in modo da poter stabilire subito se ha senso o no imbarcarsi in queste considerazioni.

Proviamo a fare qualche conto, vienimi in aiuto perche` non mi intendo molto di ottica: con un obiettivo da 60 mm di diametro (www.hq.nasa.gov/alsj/Biogon5.6_60mm_ZEISS.pdf), Il potere risolutivo angolare, espresso in secondi di arco, dovrebbe essere:

a = (135/D) = (135/60) = 2.25"Un pixel invece sottende un angolo di:

f = 61.1 mm, 4600 px

a = 1/4600 * 3600 = 0.78"Che e` circa un terzo. L`immagine quindi dovrebbe essere sovra-campionata rispetto alla proporzione canonica 2 a 1; anche se forse i conti bisognerebbe farli sulle caratteristiche della pellicola, e non sulla successiva digitalizzazione. Non so allora se in questo caso (campionamento di un campionamento) la proporzione giusta dovrebbe essere 4 a 1, o comunque superiore a quella consueta.

A parte queste considerazioni, la minima differenza in pixel discernibile dovrebbe quindi essere non inferiore a 3 ?

4600 px * (2.25/3600) = 3 pxIn sostanza, secondo me prima di imbastire modelli matematici e relative formule sarebbe opportuno chiarire bene quale dovrebbe essere il loro scopo in relazione al materiale a disposizione.

Io intendevo partire analizzando la foto che gia` avevo ricostruito nella discussione precedente (A14-9486). Facciamo altri conti veloci:

R = 1,738e6 m

distanza d cratere = 3200 m

caduta curvatura = R*(1-cos(d/R)) = 1,738e6 m * (1-cos(3200 m /1,738e6 m)) = 3 m

px = 4600 px * (3 m/3200 m) = 4 pxDevo pero` ricontrollarli perche` non sono sicuro della loro correttezza.

Io penso poi che non si debba confrontare la caduta lunare con quella terrestre, ma con la curvatura nulla: perche` l`ipotesi di una ricostruzione 1:1 di decine di km quadrati di paesaggio lunare sulla Terra la scarto.

Allego un`immagine di una mia ricostruzione tridimensionale ottenuta dai dati della sonda LRO, con la linea di orizzonte teorica terrestre (piu` alta):

Inizio da questa immagine perche` ho gia` i dati della posizione/orientamento della camera, ma ci sono foto con rilievi molto piu` lontani, ad esempio quelle di Apollo 15:

(distanza rilievo 16 km; questa ambientazione fotografica e` interessante perche` e` stata analizzata da un russo, che vi riscontra anomalie nella parallasse- vedi discussione precedente)

Io procederei in due fasi (accenno solo, dopo possiamo approfondire):

1) orientamento/posizionamento della camera usando oggetti/rilievi vicini

2) calcolo della caduta dei rilievi lontani

Accedi al sito per partecipare alle discussioni.

A me risulta che un pixel, nella zona centrale dell'immagine, corrisponda adoktorenko ha scritto:

Proviamo a fare qualche conto, vienimi in aiuto perche` non mi intendo molto di ottica: con un obiettivo da 60 mm di diametro (www.hq.nasa.gov/alsj/Biogon5.6_60mm_ZEISS.pdf), Il potere risolutivo angolare, espresso in secondi di arco, dovrebbe essere:

a = (135/D) = (135/60) = 2.25"

Un pixel invece sottende un angolo di:

f = 61.1 mm, 4600 px a = 1/4600 * 3600 = 0.78"

Che e` circa un terzo. L`immagine quindi dovrebbe essere sovra-campionata rispetto alla proporzione canonica 2 a 1; anche se forse i conti bisognerebbe farli sulle caratteristiche della pellicola, e non sulla successiva digitalizzazione. Non so allora se in questo caso (campionamento di un campionamento) la proporzione giusta dovrebbe essere 4 a 1, o comunque superiore a quella consueta.

atan(tan(47°)/2000)=1'50.6"Aggiungo anche che per me questa della risoluzione è un'ulteriore complicazione inessenziale: prendiamo per buona la risoluzione digitale delle foto a disposizione dato che i negativi originali non ce li abbiamo, e se non ricordo male alcuni se li sono pure persi.

Io penso poi che non si debba confrontare la caduta lunare con quella terrestre, ma con la curvatura nulla: perche` l`ipotesi di una ricostruzione 1:1 di decine di km quadrati di paesaggio lunare sulla Terra la scarto.

Quella che chiami curvatura nulla in realtà è un'altra cosa, l'orizzonte astronomico è una linea immaginaria, in caso di curvatura nulla l'orizzonte esisterebbe e si troverebbe comunque sotto all'orizzonte astronomico. Se l'orizzonte fosse un fondale di scena avrebbero potuto farlo simulando un qualsiasi orizzonte desiderato, se mai possiamo discutere della bontà della simulazione ma confrontarlo con un inesistente orizzonte astronomico non ha senso. Non solo, come si vede dalla linea rossa che hai aggiunto alla tua immagine basta che la fotocamera sia leggermente fuori bolla, cosa che è praticamente certa nelle foto reali, per annullare ogni considerazione, dato che non c'è modo per risalire al reale orientamento della camera rispetto alla verticale con la precisione necessaria (se ci fosse non esisterebbero i teodoliti per i rilevamenti di precisione, basterebbe una normale macchina fotografica e un software).

C'è anche da aggiungere che esisterebbe pure l'ipotesi inversa di quella che scarti tu: cioè che abbiano ricostruito sulla luna decine di km di paesaggio terrestre, ovviamente non materialmente ma modificando ad arte i dati delle sonde.

Per quanto riguarda la foto A14-9486 che intendi usare nell'analisi mi aspettavo di meglio, è controluce e di qualità molto più scarsa rispetto a quelle di A11 che avevi linkato all'inizio del thread. Nutro anche forti dubbi che il rilievo che si vede sia a 3200 m, si vede una roccia sopra l'angolo in alto a destra del LEM che, se queste fossero le distanze, dovrebbe avere dimensioni colossali, giusto per fare un esempio. L'unica cosa degna di approfondimento che noto nell'immagine è l'ombra del LEM, incoerente con le altre, per giustificarla si dovrebbe ipotizzare una forte inclinazione del terreno alla sua destra. Questa verifica mi sembra fattibile, se si dispone di una buona ricostruzione tridimensionale del sito, mentre sicuramente quella della "caduta dell'orizzonte" non lo può essere.

FranZη

Accedi al sito per partecipare alle discussioni.

- doktorenko

-

Autore della discussione

Autore della discussione

- Offline

- Senior Member

-

Registered

- Messaggi: 169

- Ringraziamenti ricevuti 8

Scusa, ma non dovrebbe esserci 47°/2 tra parentesi? Il mio conto e sbagliato clamorosamente perche` il risultato e` in radianti e non in gradi, quello giusto dovrebbe essere quindi:FranZeta ha scritto: A me risulta che un pixel, nella zona centrale dell'immagine, corrisponda a

atan(tan(47°)/2000)=1'50.6"

atan(1/4600)/pi*180= 0.0124 gradi = 45"Ho usato la risoluzione verticale (o orizzontale, è uguale) perchè è più appropriata di quella diagonale trattandosi di pixel, inoltre è proprio quella che ti interessa.

Anch`io uso la risoluzione orizzontale e la lunghezza focale in px:

lato diapositiva: 53 mm = 4000 px;

focale: 61.1 mm = 4611 pxNon capisco cosa intendi con sovracampionamento, ha senso solo fra immagini digitali, fra analogico e digitale il sovracampionamento direi che è impossibile a livello pratico, bisogna anche tenere presente che il campionamento è fatto su una stampa fotografica, non sul negativo, quindi siamo sempre ben lontani dal limite della risoluzione analogica.

Credo che le scansioni siano delle diapositive originali, e non di stampe.

Quella che chiami curvatura nulla in realtà è un'altra cosa, l'orizzonte astronomico è una linea immaginaria, in caso di curvatura nulla l'orizzonte esisterebbe e si troverebbe comunque sotto all'orizzonte astronomico. Se l'orizzonte fosse un fondale di scena avrebbero potuto farlo simulando un qualsiasi orizzonte desiderato, se mai possiamo discutere della bontà della simulazione ma confrontarlo con un inesistente orizzonte astronomico non ha senso.

Non volevo fare il confronto con l`orizzonte astronomico: intendevo solo dire che se la caduta in metri dei rilievi in lontananza dovesse essere inferiore a quella attesa, non vado ad immaginare che queste montagne (alcune alte anche km) siano state riscostruite in qualche deserto americano in scala 1:1! Per questo dicevo che non ha senso confrontare le altezze dei rilievi lunari con gli stessi presenti eventualmente sulla Terra e curvati di conseguenza, ma solo controllare che l`altezza cali opportunamente al variare della distanza.

Non solo, come si vede dalla linea rossa che hai aggiunto alla tua immagine basta che la fotocamera sia leggermente fuori bolla, cosa che è praticamente certa nelle foto reali, per annullare ogni considerazione, dato che non c'è modo per risalire al reale orientamento della camera rispetto alla verticale con la precisione necessaria (se ci fosse non esisterebbero i teodoliti per i rilevamenti di precisione, basterebbe una normale macchina fotografica e un software).

Ma infatti avevo scritto subito che e` importante conoscere con grande precisione l`orientamento della camera; ma per far questo non intendevo usare il profilo d`orizzonte piu` lontano.

Per la precisione se ne puo` parlare -e magari fare anche dei conti- perche` trovando una sagoma abbastanza nitida di un rilievo/oggetto vicino la collimazione potrebbe essere abbastanza accurata. Rimane sempre l`incognita dell`altezza del fotografo, pero` non credo sia cosi` importante come l`orientamento, anche qui bisognerebbe fae qualche conticino.

C'è anche da aggiungere che esisterebbe pure l'ipotesi inversa di quella che scarti tu: cioè che abbiano ricostruito sulla luna decine di km di paesaggio terrestre, ovviamente non materialmente ma modificando ad arte i dati delle sonde.

Questo mi sembra certamente piu` fattibilie.

Per quanto riguarda la foto A14-9486 che intendi usare nell'analisi mi aspettavo di meglio, è controluce e di qualità molto più scarsa rispetto a quelle di A11 che avevi linkato all'inizio del thread. Nutro anche forti dubbi che il rilievo che si vede sia a 3200 m, si vede una roccia sopra l'angolo in alto a destra del LEM che, se queste fossero le distanze, dovrebbe avere dimensioni colossali, giusto per fare un esempio.

Hai ragione sulla qualita`, ma avevo intenzione di iniziare da questa perche` conoscevo gia la posizione della camera. Ci sono altre immagini con rilievi piu` lontani, e per questo piu` adatte (Apollo 15).

L'unica cosa degna di approfondimento che noto nell'immagine è l'ombra del LEM, incoerente con le altre, per giustificarla si dovrebbe ipotizzare una forte inclinazione del terreno alla sua destra. Questa verifica mi sembra fattibile, se si dispone di una buona ricostruzione tridimensionale del sito, mentre sicuramente quella della "caduta dell'orizzonte" non lo può essere.

Si`, infatti era tra le cose che volevo approfondire nella discussione precedente.

Accedi al sito per partecipare alle discussioni.

Sì, pensavo che 47° fosse già la distanza angolare fra centro e margine, invece se la pellicola è da 53 mm è la distanza tra margine e margine e va divisa per 2, il risultato qui sopra è giusto. Però non è giusto questo:doktorenko ha scritto: Scusa, ma non dovrebbe esserci 47°/2 tra parentesi? Il mio conto e sbagliato clamorosamente perche` il risultato e` in radianti e non in gradi, quello giusto dovrebbe essere quindi:

atan(1/4600)/pi*180= 0.0124 gradi = 45"

La risoluzione è angolare e quindi non dipende dalla focale (la focale serve solo a trovare l'ampiezza angolare dell'immagine, una volta stabilita questa ingrandendo/rimpicciolendo l'immagine la risoluzione angolare non varia, varia la risoluzione lineare, misurata in mm per esempio). I pixel sono quelli della foto, io ho preso 4000 come cifra tonda, ma non capisco perchè li rapporti alla focale.Anch`io uso la risoluzione orizzontale e la lunghezza focale in px:

lato diapositiva: 53 mm = 4000 px; focale: 61.1 mm = 4611 px

Sposteresti soltanto il problema della messa a bolla dalla macchina fotografica ai rilievi/oggetti che vuoi usare per la collimazione. Chi ti dice qual è il loro orientamento con precisione inferiore al decimo di grado? Nemmeno se fossi sul posto con la livella in mano potresti accertartene, anzi, avresti enormi problemi anche col già menzionato teodolite. Tanto per capirci, alle nostre latitudini 0.1° è la deviazione della verticale gravitazionale rispetto alla verticale geometrica, cioè il filo a piombo, o la bolla, hanno una deviazione intrinseca di 0.1° rispetto alla direzione del centro della terra, per quanto possano essere precisi. Eppure questo non è essenziale in quasi nessuna applicazione pratica e non se ne accorge nessuno. Quello che vorresti fare tu è come verificare questa deviazione della forza di gravità usando le fotografie scattate in una scampagnata, mi sembra ben oltre i limiti del possibile.Ma infatti avevo scritto subito che e` importante conoscere con grande precisione l`orientamento della camera; ma per far questo non intendevo usare il profilo d`orizzonte piu` lontano.

Per la precisione se ne puo` parlare -e magari fare anche dei conti- perche` trovando una sagoma abbastanza nitida di un rilievo/oggetto vicino la collimazione potrebbe essere abbastanza accurata. Rimane sempre l`incognita dell`altezza del fotografo, pero` non credo sia cosi` importante come l`orientamento, anche qui bisognerebbe fae qualche conticino.

FranZη

Accedi al sito per partecipare alle discussioni.

- doktorenko

-

Autore della discussione

Autore della discussione

- Offline

- Senior Member

-

Registered

- Messaggi: 169

- Ringraziamenti ricevuti 8

teoria:

1) date due fotografie I_1 e I_2, che variano solo per la rotazione della camera R_1 e R_2

2) I_1 puo` essere trasformata in I_2 e viceversa (naturalmente nei punti inquadrati da entrambe) mediante una deformazione omografica (8 gradi di liberta`)

3) aggiungendo anche la traslazione della camera, la 1) vale solo solo per i punti giacenti sullo stesso piano

metodo Oleynik:

a) date due pose I_1 e I_2, due rotazioni della camera R_1 e R_2 (incognite), e due posizioni P_1 e P_2 (incognite)

b) i punti che compongono lo sfondo (+3km) possono essere considerati appartenenti allo stesso piano

procedura:

1) dalle immagini tolgo tutto cio` che non e` sfondo, ottenendo S_1 e S_2

2) calcolo la matrice H di trasformazione omografica di S_1 in S_2

3) applico la deformazione H all`immagine I_2, ottenendo l`immagine I_h

4) I_h e` l`immagine corrispondente ad una posa fotografica ripresa da una camera ruotata secondo R_1 e traslata di T=P_2-P_1 rispetto a I_1

5) I_1 e I_h sono quindi due scene inquadrate dallo stesso angolo e traslate di T; posso percio` calcolare la distanza degli oggetti in comune nelle due scene mediante la parallasse

Sfruttando questo metodo pensavo di:

1) ricostruire lo sfondo S_2 (+3km) mediante modellazione 3d dei dati altimetrici, con posizione e rotazione approssimativa R_2 e P_2

2) estrarre lo sfondo S_1 dalla foto Apollo

3) calcolare la matrice H S_1=S_2

4) decomporre la matrice H per ottenere R e T

5) sapendo che R = R_2-R_1 e T = P_2-P_1, risalire a R_1 e P_1Dopo allego i calcoli e le prove con i modelli 3d.

Accedi al sito per partecipare alle discussioni.

Iniziamo a chiarire la teoria. Quello che conta nelle due fotografie è che siano scattate dalla stessa posizione, angolazione e focale possono essere diverse. A questo punto basta stabilire una corrispondenza fra quattro punti delle due immagini, a tre a tre non allineati, per poter ricavare la proiettività, o omografia, fra le due immagini (matematicamente si trova di una funzione fra due piani proiettivi). Cioè ricavata la matrice H possiamo ricostruire la seconda immagine semplicemente applicando H a tutti i punti della prima. Particolare non insignificante: per riuscire a trovare H bisogna conoscere un poco di teoria degli spazi proiettivi, partendo dall'impostazione per ricavare un'omografia riportata su wikipedia H si ricava in modo assai diverso da come si farebbe per un normale sistema. Questo perchè non è una funzione tra punti dello spazio tridimensionale, ma fra piani proiettivi, magari in un altro commento spiegherò un po' più in dettaglio.doktorenko ha scritto: Prendo spunto dal metodo della parallasse di OLEG OLEYNIK ; riporto i passaggi per come li ho capiti:

teoria:

1) date due fotografie I_1 e I_2, che variano solo per la rotazione della camera R_1 e R_2

2) I_1 puo` essere trasformata in I_2 e viceversa (naturalmente nei punti inquadrati da entrambe) mediante una deformazione omografica (8 gradi di liberta`)

3) aggiungendo anche la traslazione della camera, la 1) vale solo solo per i punti giacenti sullo stesso piano

Aggiungendo una traslazione della camera non esiste più nessuna omografia, però i punti all'infinito non risentono della traslazione ed è su questo fatto che si basa il metodo di Oleynik. Quello che fa è ricavare la proiettività H scegliendo i quattro punti fra quelli "all'infinito", per i suoi scopi basta che siano ad almeno un paio di km di distanza, quindi applicandola alla prima immagine ottiene una nuova immagine il cui sfondo coincide con quello della seconda. Tutti i punti che non sono all'infinito (nel senso già chiarito) non verranno a coincidere per via dello spostamento della fotocamera, ci sarà quindi una parallasse. Misurando questa, e conoscendo già la differenza nella posizione fra i due scatti, più la distanza di qualche oggetto vicino (per esempio del margine inferiore dell'immagine, che può essere ricavata dalla focale e dall'altezza del cavalletto), può ricavare tutte le altre distanze degli oggetti che non si trovano sullo sfondo.

Veniamo ora ai tuoi propositi.

Al punto 1) si presenta già il problema fondamentale di cui parlavo nei commenti sopra, e cioè l'aggettivo "approssimativa". Se vuoi misurare una grandezza di circa 0,1° va da sè che la precisione iniziale deve essere molto maggiore, diciamo almeno un ordine di grandezza, cioè 1/100 di grado. Questo perchè l'errore dei dati iniziali si amplifica durante i calcoli (propagazione dell'errore). Quindi se non hai una ricostruzione 3D esatta al cm, con uguale precisione nella posizione della fotocamera -compresa la sua altezza dal suolo, determinante- e soprattutto una precisione di almeno 0,01° nella sua rotazione, tutto quello che segue è inutile perchè il risultato finale sarà affetto da un'imprecisione non inferiore al valore che vuoi misurare.Sfruttando questo metodo pensavo di:

1) ricostruire lo sfondo S_2 (+3km) mediante modellazione 3d dei dati altimetrici, con posizione e rotazione approssimativa R_2 e P_2 2) estrarre lo sfondo S_1 dalla foto Apollo 3) calcolare la matrice H S_1=S_2 4) decomporre la matrice H per ottenere R e T 5) sapendo che R = R_2-R_1 e T = P_2-P_1, risalire a R_1 e P_1

Facciamo però finta che al punto precedente hai una precisione assoluta, tanto nella ricostruzione 3D quanto nei dati relativi alla fotocamera. A questo punto ti converrebbe nella tua ricostruzione orientare la camera perfettamente in verticale, in questo modo puoi scegliere i 4 punti sullo sfondo dell'immagine Apollo, trovare i corrispondenti nella tua ricostruzione, calcolare la matrice H e applicarla alla foto Apollo, ottenendo così una immagine perfettamente a bolla.

Fatto ciò non dovresti far altro che verificare la distanza fra la linea orizzontale a metà immagine (orizzonte astronomico) e lo sfondo. I punti del tuo elenco 4) e 5) non hanno senso perchè la matrice non contiene nessuna informazione sullo spostamento della fotocamera, essendo stata ottenuta ipotizzando che non ci sia nessuno spostamento. Per trovare lo spostamento dovresti se mai usare il metodo Oleynik all'inverso, ma come abbiamo visto non ce n'è nessun bisogno perchè abbiamo già l'immagine che ci interessava.

Resta da capire quale sarebbe la precisione dell'immagine finale, ricavata per ipotesi -assai irrealistica- da una ricostruzione infinitamente precisa. Innanzitutto c'è l'errore nella posizione della macchina fotografica, che non possiamo conoscere esattamente. Un errore di un metro comporterebbe già un errore iniziale del 20% circa della grandezza che vuoi ricavare alla fine. Poi c'è l'errore nell'identificare i 4 punti, che potrebbe anche dipendere semplicemente da un piccolo errore nella scansione digitale della foto, potrebbe anche essere inferiore al pixel, quindi non misurabile. Tutti questi errori comportano che la matrice H sia in realtà H+e_H, dove e_H è il suo errore, e una stima prudente dice che questo errore sia almeno 4-5 volte l'errore iniziale nei dati.

Questi sono i motivi per cui ritengo impossibile fare la tua verifica. Ci sarebbe una ulteriore obiezione: se il lavoro di Oleynik è corretto lo sfondo non si trova affatto a 3 km ma a poche centinaia di metri. Dato che questa è la premessa del tuo ragionamento, se fosse falsa risulterebbe automaticamente inutile tutto ciò che segue, da premesse false può seguire tutto e il contrario di tutto: l'implicazione (formale) A=>B è sempre vera se A è falsa.

FranZη

Accedi al sito per partecipare alle discussioni.

- doktorenko

-

Autore della discussione

Autore della discussione

- Offline

- Senior Member

-

Registered

- Messaggi: 169

- Ringraziamenti ricevuti 8

FranZeta ha scritto: Ci sarebbe una ulteriore obiezione: se il lavoro di Oleynik è corretto lo sfondo non si trova affatto a 3 km ma a poche centinaia di metri. Dato che questa è la premessa del tuo ragionamento, se fosse falsa risulterebbe automaticamente inutile tutto ciò che segue, da premesse false può seguire tutto e il contrario di tutto: l'implicazione (formale) A=>B è sempre vera se A è falsa.

Quest`obiezione l`avevo sollevata anch`io, nella discussione precedente, in merito al lavoro di Oleynik: cioe` se lo sfondo non e` virtualmente all`infinito -ovvero i punti presi come riferimento non giacciono sullo stesso piano- non e` possibile usarli per ottenere la matrice H che trasforma una posa nell`altra, e quindi poter calcolare la parallasse; ma e` pur vero che se lo sfondo non e` veramente "sfondo", ma abbastanza vicino, la parallasse sara` evidente sullo (pseudo)sfondo stesso: quindi di riffa o di raffa il sistema dovrebbe funzionare.

Nel mio caso, invece, confronterei le altezze angolari di due rilievi: uno supposto sullo sfondo e uno piu` vicino; il mio sistema pero` dovrebbe essere piu` sensibile all`accuratezza del posizionamento delle camera.

Facciamo però finta che al punto precedente hai una precisione assoluta, tanto nella ricostruzione 3D quanto nei dati relativi alla fotocamera. A questo punto ti converrebbe nella tua ricostruzione orientare la camera perfettamente in verticale, in questo modo puoi scegliere i 4 punti sullo sfondo dell'immagine Apollo, trovare i corrispondenti nella tua ricostruzione, calcolare la matrice H e applicarla alla foto Apollo, ottenendo così una immagine perfettamente a bolla.

Questo e` proprio quello che intendevo fare: la mia inquadratura prevede proprio la camera a piombo; cosi` avevo scritto nel messaggio originale, poi nella modifica successiva ho riscritto "camera ruotata approssimativamente".

Adesso passo a illustrare la procedura di estrazione delle linee dei rilievi nella ricostruzione tridimensionale; prendiamo un caso semplificato:

1) la camera e` in bolla (comunque questo vale sempre, visto che nell`originale si discosta di pochi gradi da questa condizione, e la porzione di inquadratura che viene tagliata e` quella, poco interessante, ai piedi del fotografo)

2) la camera e` orientata convenzionalmente in direzione Sud (verso positivo dell` asse V dei dati altimetrici, questo per trattare il caso piu` semplice)

3) apertura del campo visivo inferiore ai 45 gradi

Procedura:

a) per prima cosa applico la curvatura ai nostri dati altimetrici:

C_x,C_y = posizione camera

R=1.738e6

theta=(u-C_x)/R

phi=(v-C_y)/R

h(u,v)=h(u,v)+R

x = ( H*np.sin(theta) )

y = ( H*np.cos(theta)* sin(phi) )

z(x,y) = ( H*np.cos(theta)* cos(phi) ) - RSe la calotta sferica e` poco estesa, possiamo prendere:

z(u,v) = ( H*np.cos(theta)* cos(phi) ) - RNella posizione della camera la caduta e` zero: e` cioe` la sommita` della nostra calotta sferica

(successivamente possiamo discutere anche sull`eventuale interpolazione del dato altimetrico)

z(u,v) e` quindi una matrice delle stesse dimensioni di h(u,v), con i dati abbassati in proporzione alla distanza dalla camera.

b) rimappatura dei dati, secondo angolo e distanza da una camera oscura di queste caratteristiche:

(metto una dimensione della diapositiva/scansione intera per semplificare):

focale = 61.1

mm = 53

dimensione_orizzontale_pixel = 4000

F = - focale/mm*pixel (F: posizione y del piano focale in pixel)

C_x,C_y = posizione camera

C_h = 1.2 m + z(C_x,C_y) *

O = (0,0,C_h) posizione foro della camera oscuraImmaginiamo ora che z(u,v) sia una griglia di punti su di un piano cartesiano, e una riga di pixel siano punti allineati di coordinate px_i(-2000 ... 2000,-F), con i l`indice del pixel da -2000 a 2000.

Da ogni px_i faccio partire una retta r_i passante per O(0,0), e calcolo i punti di intersezione tra queste rette con le rette sulle quali giacciono i punti z(u,v) allineati per righe v.

r_i: x*F - y*px_i_x = 0

h_a(i,v)= ( round(px_i_x / F), v )Ho ottenuto quindi, mediante una scansione di raggi partenti da una riga di pixel e passanti per O, una nuova griglia di altezze z(u,v) -> h_a(i,v), con i lo scostamento angolare a = atan(i/F) e v la distanza dalla camera.

Se avete notato, la trasformazione non cambia v: questo perche` possiamo considerare i punti di una stessa retta parallela al piano di proiezione tutti alla stessa distanza; ossia lo scostamento angolare dal centro avvicina i punti in rapporto al cos(a).

c) proiezione

Indichiamo ora con x e y i pixel dell`immagine da ottenere mediante proiezione attraverso il foro stenopeico O sul piano a distanza focale |F|

Trattiamo una colonna c di dati h_c = h_a(c,1...profondita` di campo) alla volta:

distanza d = 1...profondita` di campo

x_c = c + 4000/2

y_c_d = (F/d) * (C_h-h_c[d]) + 4000/2Ho quindi due triangoli rettangoli simili con i cateti corrispondenti:

d (distanza della base del rilievo) -> F (focale in pixel)

h (altezza rilievo -> y (posizione y in pixel sul sensore)

y = F/d *(C_h-h)Ogni colonna y_c alla fine conterra` i dati delle altezze dei rilievi di maggior altezza relativa proiettate sul sensore, ordinate secondo la distanza d dall`operatore: i massimi locali di ogni colonna formeranno le linee dei rilievi. (non so se ho considerato il ribaltamento dell`immagine proiettata, ma il concetto non cambia)

Accedi al sito per partecipare alle discussioni.

L'argomentazione di Oleynik è per assurdo, ed è formalmente corretta: [(A=>B)and(non B)]=>non A. Parto dall'ipotesi A="lo sfondo si trova a 3km", questa implica B="lo sfondo non ha parallasse", verifico che invece vale non B="lo sfondo ha parallasse" e concludo non A="lo sfondo non è a 3km".doktorenko ha scritto:

Quest`obiezione l`avevo sollevata anch`io, nella discussione precedente, in merito al lavoro di Oleynik: cioe` se lo sfondo non e` virtualmente all`infinito -ovvero i punti presi come riferimento non giacciono sullo stesso piano- non e` possibile usarli per ottenere la matrice H che trasforma una posa nell`altra, e quindi poter calcolare la parallasse; ma e` pur vero che se lo sfondo non e` veramente "sfondo", ma abbastanza vicino, la parallasse sara` evidente sullo (pseudo)sfondo stesso: quindi di riffa o di raffa il sistema dovrebbe funzionare.FranZeta ha scritto: Ci sarebbe una ulteriore obiezione: se il lavoro di Oleynik è corretto lo sfondo non si trova affatto a 3 km ma a poche centinaia di metri. Dato che questa è la premessa del tuo ragionamento, se fosse falsa risulterebbe automaticamente inutile tutto ciò che segue, da premesse false può seguire tutto e il contrario di tutto: l'implicazione (formale) A=>B è sempre vera se A è falsa.

Per il resto non c'è nessun bisogno che i punti siano sullo stesso piano, solo che siano abbastanza lontani. Per esempio le stelle fisse sono tutte "all'infinito" ma non sono certo sullo stesso piano. Il sistema di Oleinik funziona perchè lui non vuole concludere che lo sfondo si trova a 137,68 m dalla fotocamera, ma "a non più di 150 m", e comunque sicuramente non a 3 km. Continui ad ignorare il problema dell'errore.

Quello che stai facendo è costruire il piano proiettivo associato alla scena, questo è il motivo per cui la distanza non cambia: tutti i punti che stanno sulla stessa retta passante per l'origine sono lo stesso punto proiettivo. Normalmente si usa un metodo molto più semplice: posizionata la fotocamera in (0,0,0) si prendono le coordinate dello spazio tridimensionale e si mettono due punti al posto delle virgole: (x,y,z)-->(x:y:z) et voilà, hai il tuo piano proiettivo. I due punti stanno ad indicare che si tratta di coordinate omogenee, cioè la terna è definita a meno di una costante diversa da zero. Non voglio rovinarti il divertimento di trovarti le cose da te, ma quello che non capisco è il motivo per cui fai tutta questa procedura: se hai una ricostruzione 3D hai sicuramente la possibilità di fare un rendering che fa quello che vorresti fare tu con precisione maggiore.Da ogni px_i faccio partire una retta r_i passante per O(0,0), e calcolo i punti di intersezione tra queste rette con le rette sulle quali giacciono i punti z(u,v) allineati per righe v.

........

Se avete notato, la trasformazione non cambia v: questo perche` possiamo considerare i punti di una stessa retta parallela al piano di proiezione tutti alla stessa distanza; ossia lo scostamento angolare dal centro avvicina i punti in rapporto al cos(a).

FranZη

Accedi al sito per partecipare alle discussioni.

- doktorenko

-

Autore della discussione

Autore della discussione

- Offline

- Senior Member

-

Registered

- Messaggi: 169

- Ringraziamenti ricevuti 8

FranZeta ha scritto: Per il resto non c'è nessun bisogno che i punti siano sullo stesso piano, solo che siano abbastanza lontani. Per esempio le stelle fisse sono tutte "all'infinito" ma non sono certo sullo stesso piano.

Io ho scritto "virtualmente all`infinito", e qui siamo d`accordo, poi ho aggiunto che uno sfondo abbastanza lontano (ad esempio una rilievo montuoso a piu` di 3km) possiamo considerarlo come se fosse bidimensionale (tutti i punti sullo stesso piano): non e` corretto?

Il sistema di Oleinik funziona perchè lui non vuole concludere che lo sfondo si trova a 137,68 m dalla fotocamera, ma "a non più di 150 m", e comunque sicuramente non a 3 km. Continui ad ignorare il problema dell'errore.

Scusa ma io ho scritto che: il sistema di Oleynik funziona nei due casi perche` 1) calcola la parallasse correttamente, oppure 2) evidenzia la vicinanza dello sfondo; ho aggiunto poi che non ha bisogno di tutta la precisione che invece occorre a me nel posizionare le camere, quindi non capisco il tuo appunto. Ma anche la mia procedura non avrebbe la necessita` di essere cosi` accurata, trattando una foto con un rilievo a grande distanza e un altro oggetto piu` vicino per la collimazione.

Non voglio rovinarti il divertimento di trovarti le cose da te, ma quello che non capisco è il motivo per cui fai tutta questa procedura: se hai una ricostruzione 3D hai sicuramente la possibilità di fare un rendering che fa quello che vorresti fare tu con precisione maggiore.

Con la mia procedura ho:

1) un maggiore controllo

2) posso estrarre facilmente le sagome dei rilievi per il confronto

3) posso esibire l`eventuale anomalia in modo matematico/geometrico e non "visuale", ad esempio segnalando le altezze che non tornano mediante gli indici x,y nella mappa dei dati altimetrici.

p.s.

Chiarisco meglio cosa intendevo dire sul metodo O.:

1) volevo rettificare la mia obiezione che avevo sollevato nella discussione precedente sul vecchio sito

2) volevo dire che il metodo funziona anche perche` il supposto errore della Nasa sarebbe veramente marchiano

E se la Nasa ha commesso lo stesso errore anche nella mancata "caduta" di vette lontane (quindi di parecchi metri), dovrei con il mio sistema scoprirlo abbastanza facilmente.

Accedi al sito per partecipare alle discussioni.

Il fatto che i punti dello sfondo siano sullo stesso piano non fa alcuna differenza. Quello che conta è che siano abbastanza lontani. In questo modo si possono considerare punti all'infinito, che poi questi siano sono sullo stesso piano, il piano all'infinito appunto, dal punto di vista della posizione spaziale dei punti è irrilevante, dato che il piano all'infinito non appartiene allo spazio tridimensionale.doktorenko ha scritto: Io ho scritto "virtualmente all`infinito", e qui siamo d`accordo, poi ho aggiunto che uno sfondo abbastanza lontano (ad esempio una rilievo montuoso a piu` di 3km) possiamo considerarlo come se fosse bidimensionale (tutti i punti sullo stesso piano): non e` corretto?

Forse non ho chiarito sufficientemente il concetto che se parti da un errore iniziale E nella ricostruzione tridimensionale, puoi collimare finchè vuoi ma l'errore finale sarà necessariamente maggiore, non è una mia opinione ma è matematica pure questa.Ma anche la mia procedura non avrebbe la necessita` di essere cosi` accurata, trattando una foto con un rilievo a grande distanza e un altro oggetto piu` vicino per la collimazione.

Non direi proprio che hai maggiore controllo. Il rendering di default è impostato per ridurre al minimo i calcoli e di conseguenza gli errori nell'immagine finale. Se ricavi in 5 passaggi quello che si può ricavare in 1 hai già moltiplicato di almeno 5 volte il tuo errore. Resterebbe anche da controllare la correttezza dei passaggi, tra parentesi. In ogni caso la geometria proiettiva è matematica a tutti gli effetti, non c'è niente di "visuale", per fare un rendering il computer fa solo ed esclusivamente calcoli algebrici. Comunque direi che è meglio aspettare i risultati per altri commenti, l'unico suggerimento che ti darei a questo punto è che se non usi le coordinate omogenee che ho introdotto sopra non hai nessuna speranza di riuscire a trovare la matrice H che ti serve.Con la mia procedura ho:

1) un maggiore controllo

2) posso estrarre facilmente le sagome dei rilievi per il confronto

3) posso esibire l`eventuale anomalia in modo matematico/geometrico e non "visuale", ad esempio segnalando le altezze che non tornano mediante gli indici x,y nella mappa dei dati altimetrici.

FranZη

Accedi al sito per partecipare alle discussioni.

- doktorenko

-

Autore della discussione

Autore della discussione

- Offline

- Senior Member

-

Registered

- Messaggi: 169

- Ringraziamenti ricevuti 8

FranZeta ha scritto: Non direi proprio che hai maggiore controllo. Il rendering di default è impostato per ridurre al minimo i calcoli e di conseguenza gli errori nell'immagine finale. Se ricavi in 5 passaggi quello che si può ricavare in 1 hai già moltiplicato di almeno 5 volte il tuo errore.

La riduzione dei passaggi era proprio una mia preoccupazione: ad esempio considerare i punti di una retta parallela al piano di proiezione (come specificato sopra) tutti alla stessa distanza dal foro O, secondo me permette di semplificare il calcolo.

Resterebbe anche da controllare la correttezza dei passaggi, tra parentesi. In ogni caso la geometria proiettiva è matematica a tutti gli effetti, non c'è niente di "visuale", per fare un rendering il computer fa solo ed esclusivamente calcoli algebrici.

Naturalmente, ma per "visuale" (tra virgolette) intendevo dire che la matematica che produce l`immagine e` in secondo piano, non e` evidente come e` stato calcolata: anche se fosse una prova matematicamente corretta (per come e` stata ottenuta) non e` di immediata lettura e controllo. Mantenendo la stessa precisione e correttezza, io vorrei invece ottenere una prova di facile interpretazione: ad esempio punti, angoli, rette, ecc.; e di questi enti ho un maggior controllo usando un mio programma.

Parliamo ancora del metodo della parallasse; ho pensato a quest`altra possibile verifica, in merito alle foto AS15-86-11601 e AS15-86-11602.

procedura semplificata:

1) si risale approssimativamente alla posizione/orientamento della camera C ( R_1;P_1) nella foto I_11601

2) dal modello 3d si ottiene l`immagine I_1 inquadrata da (R_1;P_1)

3) si trasla C della distanza supposta tra le due inquadrature: P_2 = P_1 + T

4) dal modello 3d si ottiene l`immagine I_2 inquadrata da (R_1;P_2)

5) si confrontano I_1 e I_2 per valutare se esiste una parallasse visibile dello sfondo paragonabile a quella ottenuta da Oleynikprocedura completa:

1) mediante collimazione con gli originali, si trovano le posizioni/angoli C_1 = C(R_1;P_1) e C_2 = C(R_2;P_2)

2) resa 3d I_1 da C_1

3) resa 3d I_2 da C_2

4) si isola lo sfondo S_1, S_2 dalle immagini (questo si puo` fare comodamente in fase di modellazione)

5) si applica il metodo di Ol. (omografia H che minimizza la differenza dello sfondo tra due immagini) sulle rese 3d: S_2 = S_1 * H_3d

6) si applica il metodo di Ol. sugli originali: S_11602 * H_Ol = S_11601

7) si confronta il risultato, cioe` se esiste la stessa parallasse evidente e se H_3d e H_Ol sono all`incirca uguali.Volendo si puo` saltare il punto 6) usando la matrice H_Ol originale (bisognerebbe chiederla ad Oleynik), oppure direttamente le sue immagini.

Pero` per me sarebbe importante sapere i valori di H_Ol: altrimenti si potrebbe obiettare, non conoscendo la procedura esatta di passaggio da un`immagine all`altra, che e` la trasformazione usata a causare un effetto di simil-parallasse.

Accedi al sito per partecipare alle discussioni.

Il punto è che non fidarsi delle immagini del computer è come non fidarsi della sua calcolatrice, tanto varrebbe spegnere tutto e usare carta penna e calamaio. Come dicevo sopra, quello che fa il computer è prendere una scena 3D e ricavare l'immagine mediante coordinate omogenee. Posta la fotocamera nell'origine, se l'asse x è la direzione dell'inquadratura e y,z sono gli assi del piano di proiezione, allora le coordinate omogenee dei punti dell'immagine sono semplicemente (x:y:z), tradotte in coordinate cartesiane e considerando la focale diventano F*(y/x,z/x). Questo è il metodo standard, ma è anche il più semplice: 1 passaggio, qualunque altro metodo per calcolare la proiezione se è corretto deve portare allo stesso risultato in un numero di passaggi superiore.doktorenko ha scritto: La riduzione dei passaggi era proprio una mia preoccupazione: ad esempio considerare i punti di una retta parallela al piano di proiezione (come specificato sopra) tutti alla stessa distanza dal foro O, secondo me permette di semplificare il calcolo.

....

Naturalmente, ma per "visuale" (tra virgolette) intendevo dire che la matematica che produce l`immagine e` in secondo piano, non e` evidente come e` stato calcolata: anche se fosse una prova matematicamente corretta (per come e` stata ottenuta) non e` di immediata lettura e controllo. Mantenendo la stessa precisione e correttezza, io vorrei invece ottenere una prova di facile interpretazione: ad esempio punti, angoli, rette, ecc.; e di questi enti ho un maggior controllo usando un mio programma.

Dovresti anche considerare che la computer grafica è una materia altamente sviluppata e specializzata, non puoi pensare di metterti lì ragionando sui triangoli simili e trovare un metodo più efficiente di quello già implementato, sviluppato in secoli di ricerche (sì perchè la materia nasce con ser Filippo Brunelleschi...). Inoltre stiamo ignorando la questione colori/illuminazione che invece è importante per poter trovare la corrispondenza fra i punti dello sfondo. Vorrei chiarire che se faccio questi appunti non è per fare il guastafeste, è perchè mi immagino le enormi difficoltà a cui andresti incontro e perchè non c'è proprio bisogno di affrontarle, il paragone della calcolatrice qui sopra non è un'esagerazione.

Per quanto riguarda il problema dell'errore iniziale e di quale possa essere il suo peso, quella che segue è una scansione del formulario del testo Introduzione all'analisi degli errori di J.R.Taylor, propedeutico ai corsi di Laboratorio di Fisica, per dare un'idea di cosa sia la propagazione dell'errore:

Infatti questa è proprio la fonte di incertezza riguardo ai suoi risultati, se si verifica che questo passaggio è stato eseguito con la dovuta precisione quella di Oleynik diventa una dimostrazione rigorosa. Si può provare a ripetere il suo processo scegliendo 4 punti idonei sullo sfondo delle due immagini che prende in considerazione, cambiare metodo per fare questa verifica non avrebbe molto senso, anche perchè Oleynik ha già scelto la via più comoda. Comunque se confronti 2 immagini generate dal modello 3D non puoi trovare una parallasse nello sfondo, altrimenti hai sbagliato qualcosa, se lo sfondo nel modello è realmente lontano deve avere parallasse zero per due pose vicine tra loro.Pero` per me sarebbe importante sapere i valori di H_Ol: altrimenti si potrebbe obiettare, non conoscendo la procedura esatta di passaggio da un`immagine all`altra, che e` la trasformazione usata a causare un effetto di simil-parallasse.

A questo punto direi che è opportuno chiarire come si ricava la famosa matrice H, la scansione seguente è il calcolo nel caso monodimensionale, ho tolto cioè una dimensione e invece del piano siamo sulla retta proiettiva. Si vuole trovare la proiettività H che trasforma i 3 punti p,q,r in p',q'r'; ricordo che H è definita a meno di una costante diversa da zero. Prima trovo le componenti della matrice in funzione dei rapporti mu_i/lambda_i usando i primi due punti, poi ricavo questi rapporti in funzione di una costante -arbitraria- k usando il terzo. La soluzione finale (che non ho esplicitato) si ottiene sostituendo questi valori nelle espressioni delle h_ij, come si può verificare il risultato finale comprende la costante k, come è giusto che sia:

Il caso bidimensionale si tratta allo stesso modo, quello che cambia è che ora servono 4 punti e le h_ij passano da 4 a 9, mentre i sottosistemi di 2 incognite in 2 equazioni (le espressioni che precedono le frecce "=>") diventano 3x3, servirà quindi un po' più di pazienza.

FranZη

Accedi al sito per partecipare alle discussioni.

- doktorenko

-

Autore della discussione

Autore della discussione

- Offline

- Senior Member

-

Registered

- Messaggi: 169

- Ringraziamenti ricevuti 8

FranZeta ha scritto: Il punto è che non fidarsi delle immagini del computer è come non fidarsi della sua calcolatrice, tanto varrebbe spegnere tutto e usare carta penna e calamaio. Dovresti anche considerare che la computer grafica è una materia altamente sviluppata e specializzata, non puoi pensare di metterti lì ragionando sui triangoli simili e trovare un metodo più efficiente di quello già implementato, sviluppato in secoli di ricerche (sì perchè la materia nasce con ser Filippo Brunelleschi...). Inoltre stiamo ignorando la questione colori/illuminazione che invece è importante per poter trovare la corrispondenza fra i punti dello sfondo. Vorrei chiarire che se faccio questi appunti non è per fare il guastafeste, è perchè mi immagino le enormi difficoltà a cui andresti incontro e perchè non c'è proprio bisogno di affrontarle, il paragone della calcolatrice qui sopra non è un'esagerazione.

Non sei per nulla un guastafeste, anzi il rigore matematico e` il succo di questa discussione, pero` tu mi costringi a puntualizzare cose che non ho mai inteso dire: ad esempio che non mi fiderei dei programmi di modellazione tridimensionale, o ancora peggio, che non mi fiderei della matematica che ci sta dietro: io ho solo detto che vorrei avere un maggior controllo mantenendo la stessa correttezza e precisione. Un esempio di questo maggior controllo potrebbe essere conoscere, per ogni punto dell`immagine risultante, la coordinata x,y,z che l`ha prodotto: questo non lo so fare con i programmi 3d di cui dispongo; potrei imparare a farlo o usare altri programmi: magari in futuro, altrimenti non riusciamo ad avanzare con la discussione

Adesso finalmente posto un`immagine: e` la procedura "semplificata" (anche se forse sarebbe meglio indicarla come "banale") spiegata nel mio precedente messaggio: la ricostruzione approssimativa della scena della foto Apollo15-11602 da due inquadrature a circa un metro di distanza, con il rilievo da analizzare sullo sfondo.

Da questa ricostruzione non si nota nessuna parallasse del cratere.

Comunque se confronti 2 immagini generate dal modello 3D non puoi trovare una parallasse nello sfondo, altrimenti hai sbagliato qualcosa, se lo sfondo nel modello è realmente lontano deve avere parallasse zero per due pose vicine tra loro.

Hai ragione: per saperlo bastava anche solo la mappa con i punti del fotografo e del cratere: ma ora abbiamo pure la conferma "visuale"

Per il confronto:

Per completezza bisogna anche dire che la teoria di O. si basa sul presupposto (che ho adottato anch`io, senza troppi approfondimenti) che la camera non apporti nessuna percepibile deformazione oltre a quella prospettica. Questo sarebbe un punto da esaminare con cura prima di trarre conclusioni certe.

Accedi al sito per partecipare alle discussioni.

- doktorenko

-

Autore della discussione

Autore della discussione

- Offline

- Senior Member

-

Registered

- Messaggi: 169

- Ringraziamenti ricevuti 8

FranZeta ha scritto: Dovresti anche considerare che la computer grafica è una materia altamente sviluppata e specializzata, non puoi pensare di metterti lì ragionando sui triangoli simili e trovare un metodo più efficiente di quello già implementato, sviluppato in secoli di ricerche (sì perchè la materia nasce con ser Filippo Brunelleschi...). Inoltre stiamo ignorando la questione colori/illuminazione che invece è importante per poter trovare la corrispondenza fra i punti dello sfondo. Vorrei chiarire che se faccio questi appunti non è per fare il guastafeste, è perchè mi immagino le enormi difficoltà a cui andresti incontro e perchè non c'è proprio bisogno di affrontarle, il paragone della calcolatrice qui sopra non è un'esagerazione.

Per riassumere, tu dici:

1) la procedura corretta e minimale per il calcolo e` quella

2) il tuo risultato lo devi confrontare con la 1)

3) ogni passaggio supplementare e` inutile e dannoso

Fino a qua credo di aver capito, ed era infatti una mia preoccupazione fin dall`inizio, pero` io sono convinto di fare meno calcoli: ad esempio non ruoterei i punti in accordo alla camera (per averla orientata lungo un asse), ma "orienterei" la camera deformando successivamente una proiezione ottenuta con i punti non ruotati o ruotati per salti di 45 gradi.

Quindi alla fine mi sembra di fare meno passaggi, tenuto conto che la trasformazione omografica dovrei farla in ogni caso.

Per l`illuminazione in realta` ci avevo pensato: per adesso la ottengo banalmente dall`angolo del terreno con il Sole, senza calcolare le ombre gettate e la luce ambientale; per evidenziare i crateri e la direzione solare dovrebbe essere sufficiente.

Un esempio di questa tecnica applicata in 2d:

e in 3d:

p.s.

Come da tuo suggerimento, sto cercando di rielaborare la procedura mediante le coordinate omogenee; per il momento direi quindi di considerare in sospeso la questione.

Ti ringrazio per il prezioso contributo e la pazienza

Accedi al sito per partecipare alle discussioni.

Il passaggio imprescindibile è che la fotocamera sia nell'origine dello spazio tridimensionale (d'ora in poi lo chiamerò col suo nome tecnico: R^3). Indipendentemente da come sia orientata rispetto al sistema di coordinate, le coordinate omogenee del piano proiettivo (P^2) sono sempre le stesse: (x:y:z) (si trovano anche notazioni differenti per le coordinate omogenee: [x,y,z], [x;y;z] o altro ancora, io preferisco la notazione coi due punti perchè non presenta ambiguità, si usa solo ed esclusivamente in questo caso). Però se abbiamo scelto le coordinate di R^3 allineate con la macchina fotografica e la pellicola, diventa immediato ricavare le corrispondenti coordinate cartesiane nella foto, quindi è meglio fare prima una rotazione delle coordinate in R^3, piuttosto che poi una proiettività in P^2, ma prima o dopo la trasformazione va fatta e il numero di "passaggi" è sempre quello. Tra l'altro la proiettività che si usa è proprio quella indotta dalla rotazione.doktorenko ha scritto: Per riassumere, tu dici:

1) la procedura corretta e minimale per il calcolo e` quella

2) il tuo risultato lo devi confrontare con la 1)

3) ogni passaggio supplementare e` inutile e dannoso

Fino a qua credo di aver capito, ed era infatti una mia preoccupazione fin dall`inizio, pero` io sono convinto di fare meno calcoli: ad esempio non ruoterei i punti in accordo alla camera (per averla orientata lungo un asse), ma "orienterei" la camera deformando successivamente una proiezione ottenuta con i punti non ruotati o ruotati per salti di 45 gradi.

Quindi alla fine mi sembra di fare meno passaggi, tenuto conto che la trasformazione omografica dovrei farla in ogni caso.

Ecco, se usi le coordinate omogenee puoi confrontarle direttamente senza nessuna rotazione. La rotazione era comoda più che altro per il discorso della "caduta dei rilievi", parlando invece del metodo Oleynik lavorare direttamente in coordinate omogenee è la cosa migliore.Come da tuo suggerimento, sto cercando di rielaborare la procedura mediante le coordinate omogenee; per il momento direi quindi di considerare in sospeso la questione.

Di niente, colgo l'occasione per ripassare un po' di argomenti che non riguardavo da parecchi anni. In effetti l'argomento della mia tesi riguardava la geometria proiettiva, anche se da un punto di vista decisamente più astratto di quello che stiamo affrontando qui. Se ti può interessare qualche anno fa ho scritto un breve saggio sulla geometria proiettiva pensato per dei ragazzi della quarta liceo, puoi trovare una introduzione alle coordinate omogenee del piano con alcuni esempi: Rette e ConicheTi ringrazio per il prezioso contributo e la pazienza

[/color]

FranZη

Accedi al sito per partecipare alle discussioni.

- doktorenko

-

Autore della discussione

Autore della discussione

- Offline

- Senior Member

-

Registered

- Messaggi: 169

- Ringraziamenti ricevuti 8

A questo punto direi che è opportuno chiarire come si ricava la famosa matrice H ...

Se non ho capito male O. ricava la matrice usando tutti i punti dello sfondo, cercando con la forza bruta la combinazione di valori che minimizza la differenza di colore tra l`immagine di riferimento e la seconda deformata.

E` interessante anche la conclusione che trae successivamente: cioe` che la deformazione non e` dovuta alla parallasse, ma ad una deformazione dell`immagine non originata da diffetti/caratteristiche ottiche dell`obiettivo, ma causata dalla tecnica di falsificazione: la proiezione dello sfondo su di una superficie curva.

Anche questo punto potrebbe essere oggetto di analisi: ad esempio si potrebbe verificare se esiste una deformazione che varia da fotografia a fotografia, cosi` da escludere una sua origine ottica.

Cercando i punti di riferimento sull`immagine (a15-16102) credo di essere incappato in un tipo di deformazione non di origine prospettica o dovuta al posizionamento della camera:

La telecamera e` collimata sul cratere "bianco"; come si puo` notare il mio modello e` "stirato" nel senso della larghezza rispetto all`immagine della Nasa. Questo stiramento (salvo miei errori, tutt`altro che improbabili) non riesco a spiegarlo: se fosse di origine ottica, non dovrebbe dipendere dalla distanza complessiva dal centro, e non solo dalla distanza orizzontale?

@FranZeta: